亿级用户时代 分布式数据存储的架构演进与实践

在数字化转型的浪潮中,如何为亿级用户提供稳定、高效且可扩展的数据存储服务,已成为众多互联网企业面临的核心挑战。王知无在其《从Java到大数据之路》系列博客中,深入探讨了这一领域的解决方案,为我们揭示了从传统架构向分布式存储演进的技术脉络与实践智慧。

一、 亿级用户带来的数据存储挑战

当用户规模突破亿级,传统的单体数据库或简单的主从架构往往不堪重负。数据量呈指数级增长(海量性),高并发读写请求(高并发性),对服务可用性与数据一致性要求极高(高可用与强一致),并且业务需求快速变化要求架构具备弹性伸缩能力(可扩展性)。这些挑战迫使技术架构必须进行根本性的革新。

二、 分布式数据存储的核心设计思想

应对上述挑战,现代分布式存储系统普遍遵循几个核心设计原则:

- 分而治之(Sharding/Partitioning):将庞大的数据集水平拆分到多个数据库实例或节点上,分散存储与计算压力。这要求设计良好的分片键(Shard Key)以保证数据分布均匀与查询效率。

- 冗余复制(Replication):同一份数据在多个节点上保存副本,是保证高可用和容错的基础。根据一致性要求的不同,有主从复制、多主复制、无中心复制(如Paxos、Raft共识算法)等模式。

- 弹性伸缩(Elastic Scalability):系统应能根据负载动态增加或减少节点,且对应用透明。这涉及数据的自动重平衡(Rebalancing)技术。

- 最终一致性与BASE理论:在追求高性能和高可用的场景下,可以适当放宽对强一致性的要求,采用最终一致性模型。BASE(Basically Available, Soft state, Eventually consistent)理论是这类系统的基石。

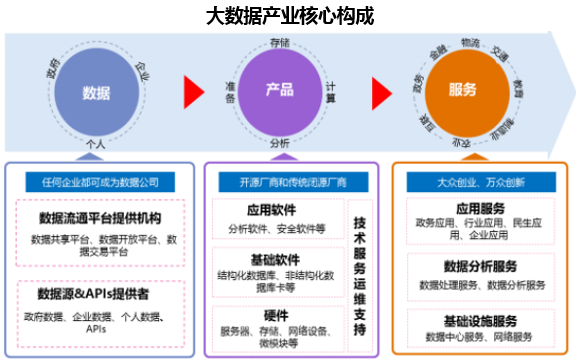

三、 主流分布式存储解决方案选型

根据数据结构与访问模式的不同,解决方案大致分为几类:

- 分布式关系型数据库:如Google Spanner(及其开源实现如TiDB、CockroachDB),在提供SQL接口和ACID事务的实现了全球级的分布与水平扩展。

- 分布式键值(Key-Value)存储:如Redis Cluster、etcd,适用于缓存、会话存储和配置管理等高性能场景。

- 分布式文档/列族存储:如MongoDB、Cassandra、HBase,擅长处理半结构化数据,具备灵活的模式和良好的水平扩展能力。

- 分布式对象存储:如AWS S3、MinIO,专为存储图片、视频、日志等海量非结构化数据设计。

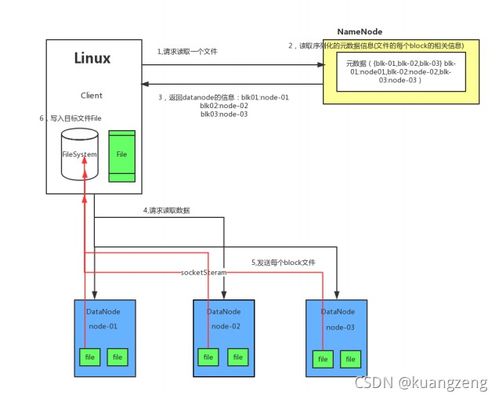

- 分布式文件系统:如HDFS、Ceph,为大数据分析(如Hadoop/Spark生态)提供底层存储支撑。

选型时需综合考量数据模型、一致性要求、读写模式、延迟敏感度以及运维成本。

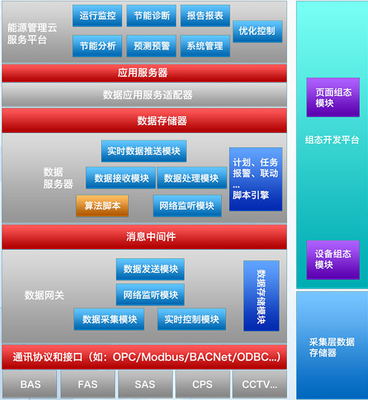

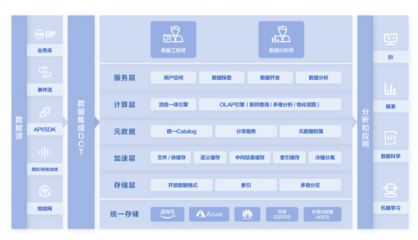

四、 从Java应用到大数据体系的架构融合

正如王知无在博客中梳理的路径,现代Java后端开发者必须理解大数据存储生态。典型的融合架构是“分层存储”:

- 在线事务层(OLTP):使用分布式关系数据库或文档数据库处理核心业务交易,保证实时性和一致性。

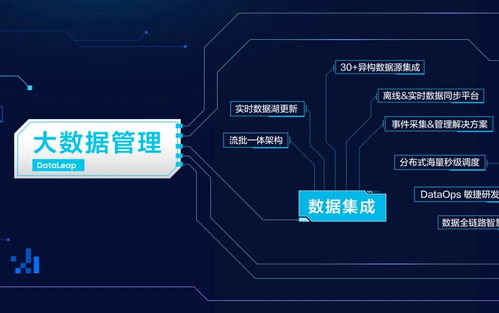

- 在线分析层(OLAP):通过数据同步工具(如Canal、Debezium)将事务层数据实时或准实时导入到像ClickHouse、Doris或大数据平台(Hive/Spark on HDFS)中,供复杂分析与报表使用。

- 数据湖与流处理层:使用Kafka作为实时数据流总线,将日志、事件数据汇入数据湖(如Iceberg、Hudi on HDFS/S3),并通过Flink/Spark Streaming进行实时处理,形成数据闭环。

五、 数据处理与存储支持服务的关键实践

构建稳定的支持服务,离不开以下实践:

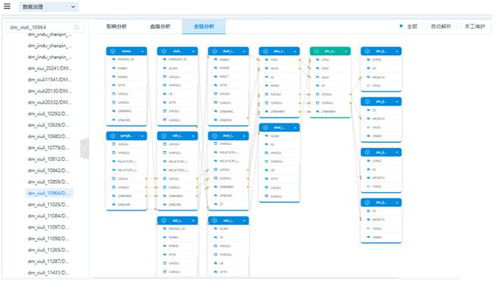

- 监控与告警:对集群健康度、性能指标(QPS、延迟、吞吐)、容量进行全方位监控。

- 自动化运维:利用Ansible、Kubernetes Operators等实现集群的自动化部署、扩缩容与升级。

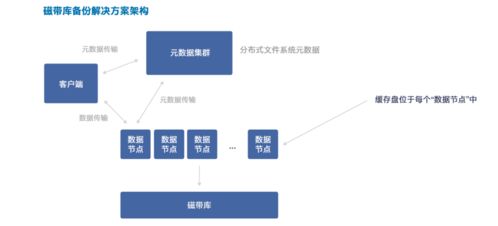

- 备份与容灾:制定跨机房、跨地域的数据备份与灾难恢复策略,定期进行容灾演练。

- 成本优化:根据数据冷热特性实施分层存储(如S3标准存储与冰川存储),清理无效数据,优化资源使用。

- 安全与治理:实施细粒度的访问控制、数据加密(传输中与静态)和审计日志,满足合规要求。

服务于亿级用户的分布式数据存储系统,没有一成不变的“银弹”。它是一条持续演进的道路,需要根据业务特性,在一致性、可用性、分区容错性(CAP定理)之间做出权衡,并灵活组合各类技术组件。王知无的分享提示我们,从扎实的Java开发走向广阔的大数据架构,核心在于掌握分布式系统的基本原理,并保持对新技术栈的开放与实践精神。只有这样,才能构建出真正支撑业务腾飞的数据基石。

如若转载,请注明出处:http://www.dvuuvd.com/product/22.html

更新时间:2026-05-28 19:56:09